- Las canciones generadas por IA de artistas fallecidos, como Blaze Foley, se han subido falsamente a Spotify

- El servicio de transmisión los está derribando mientras son vistos

- Las pistas pasaron por los procesos de verificación de contenido de Spotify a través de plataformas como Soundon

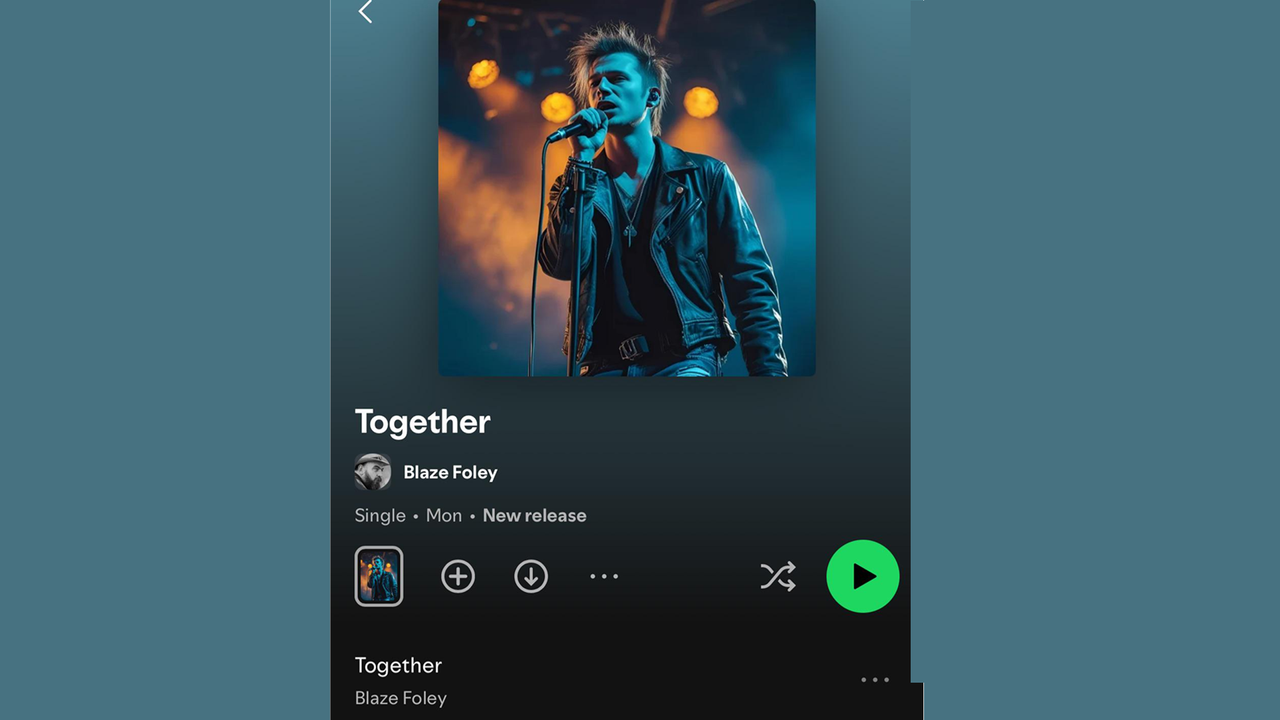

La semana pasada, una nueva canción country llamada “Together” apareció en Spotify bajo la página oficial del artista de Blaze Foley, un artista country filmado y asesinado en 1989. La balada era diferente a su otro trabajo, pero allí estaba: artes de portada, créditos e información de derechos de autor, al igual que cualquier otro sencillo nuevo. Excepto que esta no era una pista desenterrada de antes de su muerte; Era un falso generado por IA.

Después de ser marcado por los fanáticos y el sello de Foley, Lost Art Records, e informado por 404 Media, se eliminó la pista. Otra canción falsa atribuida al ícono country tardío Clark, quien falleció en 2016, también fue derribado.

El informe encontró que las pistas generadas por IA llevan etiquetas de derechos de autor que enumeran una compañía llamada Error de sintaxis como propietario, aunque se sabe poco sobre ellas. Tropear a través de canciones hechas de IA en Spotify no es inusual. Hay listas de reproducción completas de ritmos de LO-Fi de ametralladoras y chillcore ambiental que ya rastrillan millones de jugadas. Pero, esas pistas generalmente se presentan bajo nombres de artistas imaginarios y generalmente se mencionan su origen.

La atribución es lo que hace que el caso Foley sea inusual. Una canción generada por IA subida al lugar equivocado y falsamente vinculada a seres humanos reales y fallecidos es muchos pasos más allá de simplemente compartir sonidos creados en AI.

La música sintética integrada directamente en el legado de los músicos muertos largos sin el permiso de sus familias o etiquetas es una escalada del debate de larga data sobre el contenido generado por IA. Que sucedió en una plataforma gigante como Spotify y no fue atrapado por las propias herramientas del streamer es comprensiblemente preocupante.

Y a diferencia de algunos casos en los que la música generada por IA se pasa como un tributo o experimento, estos fueron tratados como lanzamientos oficiales. Aparecieron en las discografías de los artistas. Esta última controversia agrega la inquietante arruga de los artistas reales tergiversados por falsificaciones.

Artistas de IA póstumo

En cuanto a lo que sucedió al final de Spotify, la compañía atribuyó la carga a Soundon, un distribuidor de música propiedad de Tiktok.

“El contenido en cuestión viola las políticas de contenido engañosas de Spotify, lo que prohíbe la suplantación destinada a engañar, como replicar el nombre, imagen o descripción de otro creador, o hacerse pasar por una persona, marca u organización de manera engañosa”, dijo Spotify en una declaración a 404.

“Esto no está permitido. Tomamos medidas contra los licenciantes y distribuidores que no pueden vigilar este tipo de fraude y aquellos que cometen violaciones repetidas o atroces pueden y han sido eliminados permanentemente de Spotify”.

Que fue eliminado es genial, pero el hecho de que la pista apareció en absoluto sugiere un problema con la señalización de estos problemas antes. Teniendo en cuenta que Spotify procesa decenas de miles de nuevas pistas diarias, la necesidad de automatización es obvia. Sin embargo, eso significa que no puede haber verificación en los orígenes de una pista siempre que se cumplan los requisitos técnicos.

Eso importa no solo por razones artísticas, sino como una cuestión de ética y economía. Cuando la IA generativa se puede usar para fabricar canciones falsas en nombre de los músicos muertos, y no hay un mecanismo inmediato o infalible para detenerlo, entonces debe preguntarse cómo los artistas pueden probar quiénes son y obtener el crédito y las regalías que ellos o sus propiedades se han ganado.

Apple Music y YouTube también han tenido problemas para filtrar el contenido de Deepfake. Y como las herramientas de IA como Suno y Udio hacen que sea más fácil que nunca generar canciones en segundos, con letras y voces para que coincidan, el problema solo crecerá.

Hay procesos de verificación que se pueden usar, así como la construcción de etiquetas y marcas de agua en contenido generado por IA. Sin embargo, las plataformas que priorizan las cargas simplificadas pueden no ser fanáticos del tiempo y el esfuerzo adicionales involucrados.

La IA puede ser una gran herramienta para ayudar a producir y mejorar la música, pero eso es usar IA como herramienta, no como una máscara. Si una IA genera una pista y está etiquetada como tal, eso es genial. Pero si alguien pasa intencionalmente que trabaja como parte del legado de un artista, especialmente uno que ya no puede defender, eso es fraude. Puede parecer un aspecto menor de los debates de IA, pero a las personas se preocupan por la música y lo que sucede en esta industria podría tener repercusiones en cualquier otro aspecto del uso de la IA.